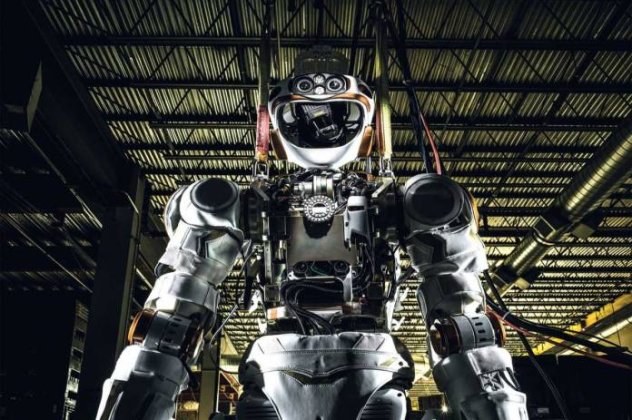

100 ειδικοί καλούν σε βοήθεια τον ΟΗΕ: σταματήστε τα "ρομπότ δολοφόνους" - θα έχουμε πόλεμο με απρόβλεπτες συνέπειες

Η «αυτόνομη θανατηφόρα» τεχνολογία θα μπορούσε να αποτελέσει το κουτί της Πανδώρας

Άμεση δράση για την αποτροπή ανάπτυξης «ρομπότ – δολοφόνων» ζητούν με επιστολή τους να αναλάβει ο ΟΗΕ 116 ειδικοί σε θέματα τεχνητής νοημοσύνης, που προειδοποιούν για μια «τρίτη πολεμική επανάσταση»

Ζητείται η απαγόρευση της χρήσης Τεχνητής Νοημοσύνης για τη διαχείριση όπλων.

«Εάν αναπτυχθούν, θα επιτρέψουν τη διεξαγωγή ένοπλων συγκρούσεων σε μεγαλύτερη κλίμακα από ό,τι έχει δει μέχρι τώρα ο κόσμος και σε χρονικά πλαίσια ταχύτερα από ό,τι μπορούν να κατανοήσουν οι άνθρωποι» αναφέρεται στην επιστολή κι προστίθεται: «Αυτά θα μπορούσαν να αποτελέσουν επίσης όπλα για την ενίσχυση της τρομοκρατίας, όπλα τα οποία τρομοκράτες θα μπορούσαν να χρησιμοποιήσουν εναντίον αθώων πληθυσμών και όπλα τα οποία θα μπορούσαν να παραβιάσουν χάκερ, ώστε αυτά να "συμπεριφέρονται" με ανεπιθύμητους τρόπους»

Οι ειδικοί προειδοποιούν, σύμφωνα με δημοσίευμα του BBC ότι δεν υπάρχει πολύς χρόνος για δράση και ζητούν να περιληφθεί στον κατάλογο απαγόρευσης όπλων βάσει της Σύμβασης των Ηνωμένων Εθνών για ορισμένα συμβατικά όπλα (CCW), αυτό που περιγράφουν ως «ανήθικη τεχνολογία».

Υπενθυμίζεται ότι το 2015, τουλάχιστον 1.000 ειδικοί σε θέματα Τεχνητής Νοημοσύνης, επιστήμονες και ερευνητές, μεταξύ των οποίων ο διακεκριμένος επιστήμονας Στίβεν Χόκινγκ, ο συνιδρυτής της Apple Στίβεν Βόσνιακ και ο Έλον Μασκ, είχαν αποστείλει επιστολή επισημαίνοντας τους κινδύνους από την ανάπτυξη αυτόνομων όπλων.

Ακολουθήστε το eirinika.gr στο Google News για ενδιαφέρουσες ειδήσεις από την Ελλάδα και τον κόσμο

Πατήστε εδώ για να διαβάσετε όλες τις αναρτήσεις του eirinika.gr